Le rang d’une matrice peut-il être nul ? Calculer le rang d'une matrice à l'aide de transformations élémentaires

Donnons une matrice :

.

.

Sélectionnons dans cette matrice  chaînes arbitraires et

chaînes arbitraires et  colonnes arbitraires

colonnes arbitraires  . Alors le déterminant

. Alors le déterminant  ème ordre, composé d'éléments matriciels

ème ordre, composé d'éléments matriciels  , situé à l'intersection des lignes et des colonnes sélectionnées, est appelé un mineur

, situé à l'intersection des lignes et des colonnes sélectionnées, est appelé un mineur  matrice d'ordre

matrice d'ordre  .

.

Définition 1.13. Rang matriciel  est le plus grand ordre du mineur non nul de cette matrice.

est le plus grand ordre du mineur non nul de cette matrice.

Pour calculer le rang d'une matrice, il faut considérer tous ses mineurs d'ordre le plus bas et, si au moins l'un d'eux est différent de zéro, procéder à la considération des mineurs d'ordre le plus élevé. Cette approche pour déterminer le rang d'une matrice est appelée la méthode limitrophe (ou méthode des mineurs limitrophes).

Problème 1.4. En utilisant la méthode des mineurs limitrophes, déterminer le rang de la matrice  .

.

.

.

Considérons par exemple les bordures de premier ordre :  . Nous passons ensuite à l’examen de certaines bordures de second ordre.

. Nous passons ensuite à l’examen de certaines bordures de second ordre.

Par exemple,  .

.

Enfin, analysons les bordures de troisième ordre.

.

.

Donc l’ordre le plus élevé d’un mineur non nul est 2, donc  .

.

Lors de la résolution du problème 1.4, vous pouvez remarquer qu’un certain nombre de mineurs limitrophes du second ordre sont non nuls. À cet égard, le concept suivant s’applique.

Définition 1.14. Une base mineure d'une matrice est tout mineur non nul dont l'ordre est égal au rang de la matrice.

Théorème 1.2.(Théorème mineur de base). Les lignes de base (colonnes de base) sont linéairement indépendantes.

Notez que les lignes (colonnes) d’une matrice sont linéairement dépendantes si et seulement si au moins l’une d’entre elles peut être représentée comme une combinaison linéaire des autres.

Théorème 1.3. Le nombre de lignes de la matrice linéairement indépendantes est égal au nombre de colonnes de la matrice linéairement indépendantes et est égal au rang de la matrice.

Théorème 1.4.(Condition nécessaire et suffisante pour que le déterminant soit égal à zéro). Pour que le déterminant  -ième commande

-ième commande  était égal à zéro, il est nécessaire et suffisant que ses lignes (colonnes) soient linéairement dépendantes.

était égal à zéro, il est nécessaire et suffisant que ses lignes (colonnes) soient linéairement dépendantes.

Calculer le rang d’une matrice en fonction de sa définition est trop fastidieux. Cela devient particulièrement important pour les matrices d’ordres élevés. A cet égard, en pratique, le rang d'une matrice est calculé sur la base de l'application des théorèmes 10.2 à 10.4, ainsi que de l'utilisation des notions d'équivalence matricielle et de transformations élémentaires.

Définition 1.15. Deux matrices  Et

Et  sont dits équivalents si leurs rangs sont égaux, c'est-à-dire

sont dits équivalents si leurs rangs sont égaux, c'est-à-dire  .

.

Si les matrices  Et

Et  sont équivalents, alors notez

sont équivalents, alors notez

.

.

Théorème 1.5. Le rang de la matrice ne change pas du fait des transformations élémentaires.

Nous appellerons transformations matricielles élémentaires  l'une des opérations suivantes sur une matrice :

l'une des opérations suivantes sur une matrice :

Remplacer les lignes par des colonnes et les colonnes par les lignes correspondantes ;

Réorganiser les lignes de la matrice ;

Rayer une ligne dont les éléments sont tous nuls ;

Multiplier une chaîne par un nombre autre que zéro ;

Ajouter aux éléments d'une ligne les éléments correspondants d'une autre ligne multipliés par le même nombre  .

.

Corollaire du théorème 1.5. Si matrice  obtenu à partir de la matrice

obtenu à partir de la matrice  en utilisant un nombre fini de transformations élémentaires, alors la matrice

en utilisant un nombre fini de transformations élémentaires, alors la matrice  Et

Et  sont équivalents.

sont équivalents.

Lors du calcul du rang d'une matrice, il convient de la réduire à une forme trapézoïdale en utilisant un nombre fini de transformations élémentaires.

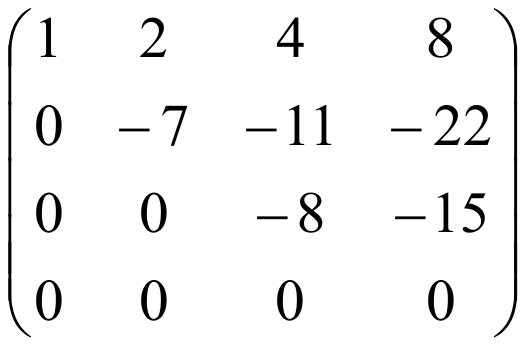

Définition 1.16. Nous appellerons trapézoïdale une forme de représentation d'une matrice lorsque, dans le mineur limitrophe de l'ordre le plus élevé autre que zéro, tous les éléments situés en dessous des diagonales disparaissent. Par exemple:

.

.

Ici  , éléments matriciels

, éléments matriciels  aller à zéro. Alors la forme de représentation d'une telle matrice sera trapézoïdale.

aller à zéro. Alors la forme de représentation d'une telle matrice sera trapézoïdale.

En règle générale, les matrices sont réduites à une forme trapézoïdale à l'aide de l'algorithme gaussien. L'idée de l'algorithme de Gauss est qu'en multipliant les éléments de la première ligne de la matrice par les facteurs correspondants, on obtient que tous les éléments de la première colonne situés en dessous de l'élément  , deviendrait nul. Ensuite, en multipliant les éléments de la deuxième colonne par les facteurs correspondants, on s'assure que tous les éléments de la deuxième colonne situés en dessous de l'élément

, deviendrait nul. Ensuite, en multipliant les éléments de la deuxième colonne par les facteurs correspondants, on s'assure que tous les éléments de la deuxième colonne situés en dessous de l'élément  , deviendrait nul. Procédez ensuite de la même manière.

, deviendrait nul. Procédez ensuite de la même manière.

Problème 1.5. Déterminez le rang d’une matrice en la réduisant à une forme trapézoïdale.

.

.

Pour faciliter l'utilisation de l'algorithme gaussien, vous pouvez intervertir la première et la troisième ligne.

.

.

C'est évident qu'ici  . Cependant, pour donner au résultat une forme plus élégante, vous pouvez continuer à transformer les colonnes.

. Cependant, pour donner au résultat une forme plus élégante, vous pouvez continuer à transformer les colonnes.

.

.

Élémentaire Les transformations matricielles suivantes sont appelées :

1) permutation de deux lignes (ou colonnes),

2) multiplier une ligne (ou une colonne) par un nombre non nul,

3) ajouter à une ligne (ou colonne) une autre ligne (ou colonne), multipliée par un certain nombre.

Les deux matrices sont appelées équivalent, si l'un d'eux est obtenu à partir de l'autre en utilisant un ensemble fini de transformations élémentaires.

Les matrices équivalentes ne sont pas, en général, égales, mais leurs rangs sont égaux. Si les matrices A et B sont équivalentes, alors cela s'écrit comme suit : A ~ B.

Canonique Une matrice est une matrice dans laquelle au début de la diagonale principale il y en a plusieurs d'affilée (dont le nombre peut être nul), et tous les autres éléments sont égaux à zéro, par exemple,

Grâce à des transformations élémentaires de lignes et de colonnes, n'importe quelle matrice peut être réduite à canonique. Le rang d'une matrice canonique est égal au nombre de un sur sa diagonale principale.

Exemple 2 Trouver le rang d'une matrice

UNE=

et lui donner une forme canonique.

Solution. De la deuxième ligne, soustrayez la première et réorganisez ces lignes :

.

.

Maintenant, des deuxième et troisième lignes, nous soustrayons la première, multipliée respectivement par 2 et 5 :

;

;

soustrayez la première de la troisième ligne ; on obtient une matrice

B =  ,

,

qui est équivalente à la matrice A, puisqu'elle en est obtenue à l'aide d'un ensemble fini de transformations élémentaires. Évidemment, le rang de la matrice B est 2, et donc r(A)=2. La matrice B peut facilement être réduite à canonique. En soustrayant la première colonne, multipliée par les nombres appropriés, de toutes les colonnes suivantes, nous remettons à zéro tous les éléments de la première ligne, à l'exception du premier, et les éléments des lignes restantes ne changent pas.

.

.

Ensuite, en soustrayant la deuxième colonne, multipliée par les nombres appropriés, de tous les suivants, nous remettons à zéro tous les éléments de la deuxième ligne, à l'exception de la seconde, et obtenons la matrice canonique : Théorème de Kronecker-Capelli

- critère de compatibilité pour un système d'équations algébriques linéaires :

Pour qu'un système linéaire soit cohérent, il faut et il suffit que le rang de la matrice étendue de ce système soit égal au rang de sa matrice principale.

Preuve (conditions de compatibilité du système)

Nécessité Laisser système

articulation Ensuite, il y a des nombres tels que .

Laisser . Prenons quelques mineures de base dans la matrice. Puisque, alors ce sera aussi la base mineure de la matrice. Alors, d'après le théorème de base mineure

, la dernière colonne de la matrice sera une combinaison linéaire des colonnes de base, c'est-à-dire les colonnes de la matrice.

La colonne des termes libres du système est donc une combinaison linéaire des colonnes de la matrice. Conséquences Nombre de variables principales

systèmes Laisserégal au rang du système.

Articulation

sera défini (sa solution est unique) si le rang du système est égal au nombre de toutes ses variables.15 . 2 Système d'équations homogène

|

|

Offre

Système d'équations homogène est toujours conjoint.

Preuve

sera défini (sa solution est unique) si le rang du système est égal au nombre de toutes ses variables.15 . 3 . Pour ce système, l’ensemble des nombres , , , est une solution.

Système d'équations homogène Dans cette section nous utiliserons la notation matricielle du système : .

La somme des solutions d'un système homogène d'équations linéaires est une solution de ce système. Une solution multipliée par un nombre est aussi une solution.

.

La somme des solutions d'un système homogène d'équations linéaires est une solution de ce système. Une solution multipliée par un nombre est aussi une solution.

Laissez-les servir de solutions au système.15 . 1 Puis et.

Laisser . Alors

Depuis, c'est la solution.15

.

5

Soit un nombre arbitraire, . ![]() Alors Conséquence Si un système homogène d’équations linéaires a une solution non nulle, alors il a une infinité de solutions différentes.

Alors Conséquence Si un système homogène d’équations linéaires a une solution non nulle, alors il a une infinité de solutions différentes. ![]() En effet, en multipliant une solution non nulle par différents nombres, on obtiendra différentes solutions.

En effet, en multipliant une solution non nulle par différents nombres, on obtiendra différentes solutions.

Définition Nous dirons que les solutions formulaire de systèmes système fondamental de solutions.»

, si les colonnes

forment un système linéairement indépendant et toute solution du système est une combinaison linéaire de ces colonnes.

« Si vous voulez apprendre à nager, entrez hardiment dans l'eau, et si vous voulez apprendre

résoudre des problèmes , Que résolvez-les D. Polya (1887-1985) ((Mathématicien. A apporté une grande contribution à la vulgarisation des mathématiques. A écrit plusieurs livres sur la façon de résoudre des problèmes et sur la manière d'enseigner la résolution de problèmes.) Considérons la matrice Soulignons-y k-rangées Et

k-colonnes k≤(min(m,n))). A partir des éléments situés à l'intersection des lignes et colonnes sélectionnées, nous composerons un déterminant

kième commande. Tous ces déterminants sont appelés mineurs de cette matrice.

Considérons tous les mineurs possibles de la matrice

UN , différent de zéro.

Rang matriciel

UN commande. Tous ces déterminants sont appelés est le plus grand ordre du mineur non nul de cette matrice. Si tous les éléments d'une matrice sont égaux à zéro, alors le rang de cette matrice est pris égal à zéro. Un mineur dont l'ordre détermine le rang de la matrice est appelé basique. Une matrice peut avoir plusieurs bases mineures. k≤(min(m,n)) résolvez-les Rang matriciel désigné par r(UNE) . Si r(UNE)=r(B).

, alors les matrices

- Lorsqu’une matrice est transposée, son rang ne change pas.

- Si vous supprimez la ligne (colonne) zéro de la matrice, le rang de la matrice ne changera pas.

- Le rang de la matrice ne change pas lors des transformations matricielles élémentaires.

Par transformations élémentaires on entend :

- Réorganiser les lignes de la matrice ;

- Multiplier une chaîne par un nombre autre que zéro ;

- Ajouter aux éléments d'une ligne les éléments correspondants d'une autre ligne, multipliés par un nombre arbitraire.

Lors du calcul du rang d'une matrice, des transformations élémentaires, la méthode de réduction de la matrice sous une forme pas à pas et la méthode des mineurs limitrophes peuvent être utilisées.

Méthode de réduction d'une matrice en pas à pas L'idée est qu'à l'aide de transformations élémentaires cette matrice est réduite à une matrice en escalier.

La matrice s'appelle fait un pas , si dans chacune de ses lignes le premier élément non nul est à droite que dans le précédent (c'est-à-dire que des marches sont obtenues, la hauteur de chaque marche doit être égale à un).

Exemples de matrices d'étapes :

Exemples de matrices non échelonnées :

EXEMPLE: Trouvez le rang de la matrice :

SOLUTION:

Réduisons cette matrice à une matrice en étapes à l'aide de transformations élémentaires.

1. Échangez les première et troisième lignes.

2. Nous obtenons des zéros sous un dans la première colonne.

En ajoutant la première ligne multipliée par (-3) à la deuxième ligne, la première ligne multipliée par (-5) à la troisième ligne et la première ligne multipliée par (-3) à la quatrième ligne, on obtient

Pour indiquer plus clairement où vous devez obtenir des zéros, dessinons des étapes dans la matrice. (La matrice sera échelonnée s'il y a des zéros partout sous les échelons)

3. En ajoutant la deuxième ligne multipliée par (-1) à la troisième ligne et la deuxième ligne multipliée par (-1) à la quatrième ligne, nous obtenons des zéros sous les étapes de la deuxième colonne.

Si nous dessinons à nouveau les marches, nous verrons que la matrice est échelonnée.

Son rang est r=3(le nombre de lignes de la matrice d'étapes, dans chacune desquelles au moins un élément est différent de zéro). Par conséquent, le rang de cette matrice r=3.

La solution peut s'écrire ainsi :

(Les chiffres romains indiquent les numéros de ligne)

Réponse : r=3.

Commande mineure k+1, contenant un mineur d'ordre k appelé à la limite du mineur.

Méthode mineure limite est basé sur le fait que le rang d'une matrice donnée est égal à l'ordre d'un mineur de cette matrice qui est non nul, et tous les mineurs qui la bordent sont égaux à zéro.

Soit A une matrice de tailles m\times n et k un nombre naturel n'excédant pas m et n : k\leqslant\min\(m;n\). Ordre mineur du kème la matrice A est le déterminant d'une matrice d'ordre k formée par les éléments à l'intersection de k lignes et k colonnes arbitrairement choisies de la matrice A. Lors de la désignation des mineurs, nous indiquerons les numéros des lignes sélectionnées comme indices supérieurs et les numéros des colonnes sélectionnées comme indices inférieurs, en les classant par ordre croissant.

Exemple 3.4.Écrire des mineurs de différents ordres de la matrice

A=\begin(pmatrix)1&2&1&0\\ 0&2&2&3\\ 1&4&3&3\end(pmatrix)\!.

Solution. La matrice A a des dimensions 3\times4 . Il compte : 12 mineurs du 1er ordre, par exemple mineur M_(()_2)^(()_3)=\det(a_(32))=4; 18 mineurs de 2ème ordre, par exemple, M_(()_(23))^(()^(12))=\begin(vmatrix)2&1\\2&2\end(vmatrix)=2; 4 mineurs de 3ème ordre, par exemple,

M_(()_(134))^(()^(123))= \begin(vmatrix)1&1&0\\0&2&3\\ 1&3&3 \end(vmatrix)=0.

Dans une matrice A de taille m\times n, le mineur d'ordre r est appelé basique, s'il est différent de zéro et que tous les mineurs d'ordre (r+1)-ro sont égaux à zéro ou n'existent pas du tout.

Rang matriciel est appelé l'ordre de la base mineure. Il n’y a pas de base mineure dans une matrice nulle. Par conséquent, le rang d’une matrice nulle est, par définition, égal à zéro. Le rang de la matrice A est noté \nom de l'opérateur(rg)A.

Exemple 3.5. Trouver tous les mineurs de base et le rang matriciel

A=\begin(pmatrix)1&2&2&0\\0&2&2&3\\0&0&0&0\end(pmatrix)\!.

Solution. Tous les mineurs du troisième ordre de cette matrice sont égaux à zéro, puisque ces déterminants ont une troisième ligne nulle. Par conséquent, seul un mineur du second ordre situé dans les deux premières lignes de la matrice peut être basique. En parcourant 6 mineurs possibles, on sélectionne non nul

M_(()_(12))^(()^(12))= M_(()_(13))^(()^(12))= \begin(vmatrix)1&2\\0&2 \end( vmatrix)\!,\quad M_(()_(24))^(()^(12))= M_(()_(34))^(()^(12))= \begin(vmatrix) 2&0\\2&3\end(vmatrix)\!,\quad M_(()_(14))^(()^(12))= \begin(vmatrix)1&0\\0&3\end(vmatrix)\!.

Chacun de ces cinq mineurs est un mineur de base. Le rang de la matrice est donc 2.

Remarques 3.2

1. Si dans une matrice tous les mineurs du kième ordre sont égaux à zéro, alors les mineurs d’ordre supérieur sont également égaux à zéro. En effet, en développant le mineur d'ordre (k+1)-ro sur n'importe quelle ligne, on obtient la somme des produits des éléments de cette ligne par les mineurs d'ordre k, et ils sont égaux à zéro.

2. Le rang d'une matrice est égal à l'ordre le plus élevé du mineur non nul de cette matrice.

3. Si une matrice carrée est non singulière, alors son rang est égal à son ordre. Si une matrice carrée est singulière, alors son rang est inférieur à son ordre.

4. Les désignations sont également utilisées pour le rang \operatorname(Rg)A,~ \operatorname(rang)A,~ \operatorname(rank)A.

5. Rang de la matrice de blocs est défini comme le rang d'une matrice ordinaire (numérique), c'est-à-dire quelle que soit sa structure de bloc. Dans ce cas, le rang d'une matrice de blocs n'est pas inférieur aux rangs de ses blocs : \nom de l'opérateur(rg)(A\mid B)\geqslant\nom de l'opérateur(rg)A résolvez-les \nom de l'opérateur(rg)(A\mid B)\geqslant\nom de l'opérateur(rg)B, puisque tous les mineurs de la matrice A (ou B ) sont également des mineurs de la matrice bloc (A\mid B) .

Théorèmes sur la base mineure et le rang de la matrice

Considérons les principaux théorèmes exprimant les propriétés de dépendance linéaire et d'indépendance linéaire des colonnes (lignes) d'une matrice.

Théorème 3.1 sur la base mineure. Dans une matrice arbitraire A, chaque colonne (ligne) est une combinaison linéaire des colonnes (lignes) dans lesquelles se trouve la base mineure.

En effet, sans perte de généralité, nous supposons que dans une matrice A de taille m\times n la base mineure est située dans les r premières lignes et les r premières colonnes. Considérez le déterminant

D=\begin(vmatrix)~ a_(11)&\cdots&a_(1r)\!\!&\vline\!\!&a_(1k)~\\ ~\vdots&\ddots &\vdots\!\!&\ vline\!\!&\vdots~\\ ~a_(r1)&\cdots&a_(rr)\!\!&\vline\!\!&a_(rk)~\\\hline ~a_(s1)&\cdots&a_ (sr)\!\!&\vline\!\!&a_(sk)~\end(vmatrix),

qui est obtenu en affectant les éléments correspondants de la ième ligne et de la kième colonne à la base mineure de la matrice A. Notez que pour tout 1\leqslant s\leqslant m et ce déterminant est égal à zéro. Si s\leqslant r ou k\leqslant r , alors le déterminant D contient deux lignes identiques ou deux colonnes identiques. Si s>r et k>r, alors le déterminant D est égal à zéro, puisqu'il est mineur d'ordre (r+l)-ro. En développant le déterminant le long de la dernière ligne, on obtient

a_(s1)\cdot D_(r+11)+\ldots+ a_(sr)\cdot D_(r+1r)+a_(sk)\cdot D_(r+1\,r+1)=0,

où D_(r+1\,j) sont les compléments algébriques des éléments de la dernière ligne. Notez que D_(r+1\,r+1)\ne0 puisqu'il s'agit d'une base mineure. C'est pourquoi

a_(sk)=\lambda_1\cdot a_(s1)+\ldots+\lambda_r\cdot a_(sr), Où \lambda_j=-\frac(D_(r+1\,j))(D_(r+1\,r+1)),~j=1,2,\ldots,r.

En écrivant la dernière égalité pour s=1,2,\ldots,m, on obtient

\begin(pmatrix)a_(1k)\\\vdots\\a_(mk)\end(pmatrix)= \lambda_1\cdot\! \begin(pmatrix)a_(11)\\\vdots\\a_(m1)\end(pmatrix)+\ldots \lambda_r\cdot\! \begin(pmatrix)a_(1r)\\\vdots\\a_(mr)\end(pmatrix)\!.

ceux. kème colonne (pour tout 1\leqslant k\leqslant n) est une combinaison linéaire des colonnes de la base mineure, ce que nous devions prouver.

Le théorème mineur de base sert à prouver les théorèmes importants suivants.

Condition pour que le déterminant soit nul

Théorème 3.2 (condition nécessaire et suffisante pour que le déterminant soit nul). Pour qu'un déterminant soit égal à zéro, il faut et suffisant qu'une de ses colonnes (une de ses lignes) soit une combinaison linéaire des colonnes (lignes) restantes.

En effet, la nécessité découle du théorème mineur de base. Si le déterminant d'une matrice carrée d'ordre n est égal à zéro, alors son rang est inférieur à n, c'est-à-dire au moins une colonne n'est pas incluse dans la base mineure. Alors cette colonne choisie, par le Théorème 3.1, est une combinaison linéaire des colonnes dans lesquelles se situe la base mineure. En ajoutant, si nécessaire, à cette combinaison d'autres colonnes à coefficients nuls, on obtient que la colonne sélectionnée est une combinaison linéaire des colonnes restantes de la matrice. La suffisance découle des propriétés du déterminant. Si par exemple la dernière colonne A_n du déterminant \det(A_1~A_2~\cdots~A_n) exprimé linéairement à travers le reste

A_n=\lambda_1\cdot A_1+\lambda_2\cdot A_2+\ldots+\lambda_(n-1)\cdot A_(n-1),

puis ajouter à A_n la colonne A_1 multipliée par (-\lambda_1), puis la colonne A_2 multipliée par (-\lambda_2), etc. colonne A_(n-1) multiplié par (-\lambda_(n-1)) on obtient le déterminant \det(A_1~\cdots~A_(n-1)~o) avec une colonne nulle égale à zéro (propriété 2 du déterminant).

Invariance du rang matriciel sous transformations élémentaires

Théorème 3.3 (sur l'invariance du rang sous transformations élémentaires). Lors des transformations élémentaires des colonnes (lignes) d'une matrice, son rang ne change pas.

En effet, qu’il en soit ainsi. Supposons qu'à la suite d'une transformation élémentaire des colonnes de la matrice A nous obtenions la matrice A". Si une transformation de type I a été effectuée (permutation de deux colonnes), alors tout mineur (r+l)-ro de l'ordre de la matrice A" est soit égal au mineur (r+l )-ro correspondant de l'ordre de la matrice A, soit en diffère en signe (propriété 3 du déterminant). Si une transformation de type II a été effectuée (en multipliant la colonne par le nombre \lambda\ne0 ), alors tout mineur (r+l)-ro de l'ordre de la matrice A" est soit égal au mineur correspondant (r+l) -ro de l'ordre de la matrice A ou différent de celle-ci facteur \lambda\ne0 (propriété 6 du déterminant). Si une transformation de type III a été effectuée (en ajoutant à une colonne une autre colonne multipliée par le nombre \Lambda), alors n'importe quel mineur du (r+1)ème ordre de la matrice A" est soit égal au mineur correspondant. (r+1)-ème ordre de la matrice A (propriété 9 du déterminant), soit est égal à la somme de deux mineurs (r+l)-ro de l'ordre de la matrice A (propriété 8 du déterminant). Donc, sous une transformation élémentaire de tout type, tous les mineurs (r+l)-ro de l'ordre de la matrice A" sont égaux à zéro, puisque tous les mineurs (r+l)-ro de l'ordre de la matrice A sont égal à zéro. Ainsi, il a été prouvé que lors des transformations élémentaires des colonnes, la matrice de rang ne peut pas augmenter. Puisque les transformations inverses des transformations élémentaires sont élémentaires, le rang de la matrice ne peut pas diminuer lors des transformations élémentaires des colonnes, c'est-à-dire qu'il est de même. prouvé que le rang de la matrice ne change pas lors des transformations élémentaires des lignes.

Corollaire 1. Si une ligne (colonne) d'une matrice est une combinaison linéaire de ses autres lignes (colonnes), alors cette ligne (colonne) peut être supprimée de la matrice sans changer son rang.

En effet, une telle chaîne peut être rendue nulle à l'aide de transformations élémentaires, et une chaîne nulle ne peut pas être incluse dans la base mineure.

Corollaire 2. Si la matrice se réduit à la forme la plus simple (1.7), alors

\operatorname(rg)A=\operatorname(rg)\Lambda=r\,.

En effet, la matrice de la forme la plus simple (1.7) a une base mineure du rème ordre.

Corollaire 3. Toute matrice carrée non singulière est élémentaire, autrement dit, toute matrice carrée non singulière est équivalente à une matrice identité du même ordre.

En effet, si A est une matrice carrée non singulière d’ordre n, alors \nom de l'opérateur(rg)A=n(voir paragraphe 3 des commentaires 3.2). Ainsi, en ramenant la matrice A à la forme la plus simple (1.7) par transformations élémentaires, on obtient la matrice identité \Lambda=E_n , puisque \operatorname(rg)A=\operatorname(rg)\Lambda=n(voir Corollaire 2). Par conséquent, la matrice A est équivalente à la matrice identité E_n et peut en être obtenue grâce à un nombre fini de transformations élémentaires. Cela signifie que la matrice A est élémentaire.

Théorème 3.4 (sur le rang de la matrice). Le rang d'une matrice est égal au nombre maximum de lignes linéairement indépendantes de cette matrice.

En fait, laissez \nom de l'opérateur(rg)A=r. Alors la matrice A a r lignes linéairement indépendantes. Ce sont les vers dans lesquels se situe la base mineure. S'ils étaient linéairement dépendants, alors ce mineur serait égal à zéro d'après le théorème 3.2, et le rang de la matrice A ne serait pas égal à r. Montrons que r est le nombre maximum de lignes linéairement indépendantes, c'est-à-dire toutes les lignes p dépendent linéairement pour p>r. En effet, on forme la matrice B à partir de ces p lignes. Puisque la matrice B fait partie de la matrice A, alors \operatorname(rg)B\leqslant \operatorname(rg)A=r Cela signifie qu'au moins une ligne de la matrice B n'est pas incluse dans la base mineure de cette matrice. Ensuite, d'après le théorème de la base mineure, il est égal à une combinaison linéaire des lignes dans lesquelles se trouve la base mineure. Par conséquent, les lignes de la matrice B sont linéairement dépendantes. Ainsi, la matrice A comporte au plus r lignes linéairement indépendantes. Corollaire 1. Le nombre maximum de lignes linéairement indépendantes dans une matrice est égal au nombre maximum de colonnes linéairement indépendantes : \operatorname(rg)A=\operatorname(rg)A^T. Cet énoncé découle du théorème 3.4 si on l'applique aux lignes d'une matrice transposée et en tenant compte du fait que les mineurs ne changent pas lors de la transposition (propriété 1 du déterminant). Corollaire 2. Lors des transformations élémentaires des lignes d'une matrice, la dépendance linéaire (ou indépendance linéaire) de tout système de colonnes de cette matrice est préservée. En fait, choisissons k colonnes quelconques d’une matrice A donnée et composons à partir d’elles la matrice B. Supposons que la matrice A" soit obtenue à la suite de transformations élémentaires des lignes de la matrice A, et que la matrice B" soit obtenue à la suite des mêmes transformations des lignes de la matrice B. Par le théorème 3.3 \operatorname(rg)B"=\operatorname(rg)B. Par conséquent, si les colonnes de la matrice B étaient linéairement indépendantes, c'est-à-dire k=\nom de l'opérateur(rg)B(voir Corollaire 1), alors les colonnes de la matrice B" sont également linéairement indépendantes, puisque k=\nom de l'opérateur(rg)B". Si les colonnes de la matrice B étaient linéairement dépendantes (k>\nom de l'opérateur(rg)B), alors les colonnes de la matrice B" dépendent également linéairement (k>\nom de l'opérateur(rg)B"). Par conséquent, pour toutes les colonnes de la matrice A, la dépendance linéaire ou l'indépendance linéaire est préservée sous les transformations de lignes élémentaires. Remarques 3.3 1. En vertu du corollaire 1 du théorème 3.4, la propriété des colonnes indiquée dans le corollaire 2 est également vraie pour tout système de lignes matricielles si les transformations élémentaires sont effectuées uniquement sur ses colonnes. 2. Le corollaire 3 du théorème 3.3 peut être affiné comme suit : toute matrice carrée non singulière, utilisant des transformations élémentaires uniquement de ses lignes (ou uniquement de ses colonnes), peut être réduite à une matrice identité du même ordre. En fait, en utilisant uniquement des transformations élémentaires de lignes, toute matrice A peut être réduite à la forme simplifiée \Lambda (Fig. 1.5) (voir Théorème 1.1). Puisque la matrice A est non singulière (\det(A)\ne0), ses colonnes sont linéairement indépendantes. Cela signifie que les colonnes de la matrice \Lambda sont également linéairement indépendantes (Corollaire 2 du Théorème 3.4). Par conséquent, la forme simplifiée \Lambda d’une matrice non singulière A coïncide avec sa forme la plus simple (Fig. 1.6) et est la matrice identité \Lambda=E (voir corollaire 3 du théorème 3.3). Ainsi, en transformant uniquement les lignes d’une matrice non singulière, on peut la réduire à la matrice identité. Un raisonnement similaire est valable pour les transformations élémentaires des colonnes d'une matrice non singulière. Théorème 3.5 (sur le rang du produit des matrices).Rang du produit et somme des matrices

\operatorname(rg)(A\cdot B)\leqslant \min\(\operatorname(rg)A,\operatorname(rg)B\).

En effet, laissez les matrices A et B avoir des tailles m\times p et p\times n . Affectons à la matrice A la matrice C=AB\colon\,(A\mid C). Bien sûr que \operatorname(rg)C\leqslant\operatorname(rg)(A\mid C), puisque C fait partie de la matrice (A\mid C) (voir paragraphe 5 des remarques 3.2). A noter que chaque colonne C_j, selon l'opération de multiplication matricielle, est une combinaison linéaire de colonnes A_1,A_2,\ldots,A_p matrices A=(A_1~\cdots~A_p) :

C_(j)=A_1\cdot b_(1j)+A_2\cdot b_(2j)+\ldots+A_(p)\cdot b_pj),\quad j=1,2,\ldots,n.

Une telle colonne peut être supprimée de la matrice (A\mid C) sans changer son rang (Corollaire 1 du Théorème 3.3). En barrant toutes les colonnes de la matrice C, on obtient : \nom de l'opérateur(rg)(A\mid C)=\nom de l'opérateur(rg)A. D'ici, \operatorname(rg)C\leqslant\operatorname(rg)(A\mid C)=\operatorname(rg)A. De même, on peut prouver que la condition est simultanément satisfaite \nom de l'opérateur(rg)C\leqslant\nom de l'opérateur(rg)B, et tirer une conclusion sur la validité du théorème.

Conséquence. Si A est une matrice carrée non singulière, alors \nom de l'opérateur(rg)(AB)= \nom de l'opérateur(rg)B résolvez-les \nom de l'opérateur(rg)(CA)=\nom de l'opérateur(rg)C, c'est-à-dire le rang d'une matrice ne change pas lorsqu'on la multiplie depuis la gauche ou la droite par une matrice carrée non singulière.

Théorème 3.6 sur le rang des sommes des matrices. Le rang de la somme des matrices ne dépasse pas la somme des rangs des termes :

\operatorname(rg)(A+B)\leqslant \operatorname(rg)A+\operatorname(rg)B.

En effet, créons une matrice (A+B\milieu A\milieu B). Notez que chaque colonne de la matrice A+B est une combinaison linéaire de colonnes des matrices A et B. C'est pourquoi \operatorname(rg)(A+B\mid A\mid B)= \operatorname(rg)(A\mid B). Considérant que le nombre de colonnes linéairement indépendantes dans la matrice (A\mid B) ne dépasse pas \nom de l'opérateur(rg)A+\nom de l'opérateur(rg)B, un \operatorname(rg)(A+B)\leqslant \operatorname(rg)(A+B\mid A\mid B)(voir section 5 des Remarques 3.2), on obtient l'inégalité en cours de démonstration.